À propos des cookies sur ce site Pour fonctionner correctement, nos sites Internet nécessitent certains cookies (requis). En outre, d'autres cookies peuvent être utilisés avec votre consentement pour analyser l'utilisation d'un site, améliorer l'expérience des utilisateurs et à des fins publicitaires. Pour plus informations, passez en revue vos options de préférences en. En visitant notre site Web, vous acceptez que nous traitions les informations comme décrit dans ladéclaration de confidentialité d’IBM. Pour faciliter la navigation, vos préférences en matière de cookie seront partagées dans les domaines Web d'IBM énumérés ici.

Application des tests d'équité aux expérimentations AutoAI

Dernière mise à jour : 28 nov. 2024

Évaluez une expérience pour l'équité afin de vous assurer que vos résultats ne sont pas biaisés en faveur d'un groupe par rapport à un autre.

Limitations

Les évaluations d'équité ne sont pas prises en charge pour les expériences de séries temporelles.

Évaluation des expérimentations et des modèles d'équité

Lorsque vous définissez une expérimentation et que vous produisez un modèle d'apprentissage automatique, vous voulez être sûr que vos résultats soient fiables et sans biais. Un biais dans un modèle d'apprentissage automatique peut se produire lorsque le modèle apprend les mauvaises leçons lors de l'entraînement. Ce scénario peut se produire lorsque des données insuffisantes ou une mauvaise collecte de données ou une mauvaise gestion se traduisent par un mauvais résultat lorsque le modèle génère des prévisions. Il est important d'évaluer une expérience pour déceler les signes de biais afin de les corriger si nécessaire et de renforcer la confiance dans les résultats du modèle.

AutoAI inclut les outils, techniques et fonctions suivants pour vous aider à évaluer et à corriger une expérimentation de biais.

Définitions et termes

Attribut d'équité -Le biais ou l'équité est généralement mesuré à l'aide d'un attribut d'équité tel que le sexe, l'origine ethnique ou l'âge.

Groupe surveillé / référence - Le groupe surveillé est l'attribut de valeurs d'équité pour lequel vous souhaitez mesurer le biais. Les valeurs du groupe surveillé sont comparées aux valeurs du groupe de référence. Par exemple, si Fairness Attribute=Gender

Résultat favorable / défavorable -Un concept important dans la détection des biais est celui de résultat favorable et défavorable du modèle. Par exemple, Claim approvedClaim denied

Impact disparate -Mesure utilisée pour mesurer le biais (calculé comme le rapport entre le pourcentage de résultats favorables pour le groupe surveillé et le pourcentage de résultats favorables pour le groupe de référence). Le biais est dit exister si la valeur d'impact disparate est inférieure à un seuil spécifié.

Par exemple, si 80% des réclamations d'assurance faites par des hommes sont approuvées, mais que 60% seulement des réclamations faites par des femmes sont approuvées, l'impact est: 60/80 = 0.75. Généralement, la valeur de seuil pour le biais est de 0,8. Comme ce ratio d'impact disparate est inférieur à 0,8, le modèle est considéré comme biaisé.

Notez que lorsque le rapport d'impact disparate est supérieur à 1.25 [ la valeur inverse (impact1/disparate ) est inférieure au seuil 0.8], il est également considéré comme biaisé.

Regardez une vidéo sur l'évaluation et l'amélioration de l'équité

Regardez cette vidéo pour voir comment évaluer un modèle d'apprentissage automatique pour l'équité afin de vous assurer que vos résultats ne sont pas biaisés.

Cette vidéo fournit une méthode visuelle pour apprendre les concepts et les tâches de cette documentation.

Application d'un test d'équité pour une expérimentation AutoAI dans l'interface utilisateur

Ouvrez les paramètres d'expérimentation.

Cliquez sur l'onglet Équité.

Activez les options d'équité. Les options sont les suivantes :

- Évaluation de l'équité : Activez cette option pour vérifier chaque pipeline pour le biais en calculant la ration d'impact disparate. Cette méthode permet de suivre si un pipeline a tendance à fournir un résultat favorable (préféré) pour un groupe plus souvent qu'un autre.

- Seuil d'équité: définissez un seuil d'équité pour déterminer s'il existe un biais dans un pipeline en fonction de la valeur du rapport d'impact disparate. La valeur par défaut est 80, ce qui représente un rapport d'impact disparate inférieur à 0.80.

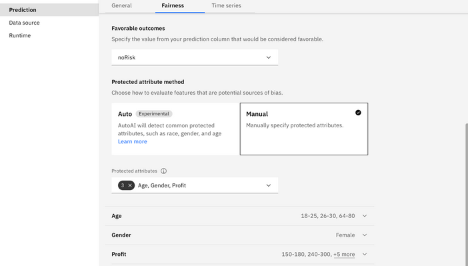

- Résultats favorables : Indiquez la valeur de votre colonne de prévision qui serait considérée comme favorable. Par exemple, la valeur peut être "approuvé", "accepté" ou tout ce qui correspond à votre type de prévision.

- Méthode d'attribut protégée automatique : Choisissez comment évaluer les fonctions qui sont une source potentielle de biais. Vous pouvez spécifier la détection automatique, auquel cas AutoAI détecte les attributs couramment protégés, notamment le sexe, l'origine ethnique, l'état civil, l'âge et le code postal. Dans chaque catégorie, AutoAI tente de déterminer un groupe protégé. Par exemple, pour la catégorie

sexfemale

Remarque: En mode automatique, il est probable qu'une fonction ne soit pas identifiée correctement en tant qu'attribut protégé si elle comporte des valeurs non typiques, par exemple, dans une langue autre que l'anglais. La détection automatique n'est prise en charge que pour l'anglais.- Méthode d'attribut protégée manuelle : Spécifiez manuellement un résultat et fournissez l'attribut protégé en choisissant dans une liste d'attributs. Notez que lorsque vous fournissez manuellement des attributs, vous devez ensuite définir un groupe et indiquer s'il est susceptible d'avoir les résultats attendus (le groupe de référence) ou s'il doit être révisé pour détecter l'écart par rapport aux résultats attendus (le groupe surveillé).

Par exemple, cette image montre un ensemble de groupes d'attributs spécifiés manuellement pour la surveillance.

Enregistrez les paramètres pour appliquer et exécuter l'expérimentation pour appliquer l'évaluation de l'équité à vos pipelines.

Remarques :

- Pour les modèles multiclasses, vous pouvez sélectionner plusieurs valeurs dans la colonne de prévision pour les classer comme favorables ou non.

- Pour les modèles de régression, vous pouvez spécifier une plage de résultats considérés comme favorables ou non.

- Actuellement, les évaluations d'équité ne sont pas disponibles pour les expériences de séries temporelles.

Liste des attributs détectés automatiquement pour la mesure de l'équité

Lorsque la détection automatique est activée, AutoAI détecte automatiquement les attributs suivants s'ils sont présents dans les données d'apprentissage. Les attributs doivent être en anglais.

- age

- citoyen_statut

- couleur

- handicap

- ethnie

- sexe

- information_génétique

- handicap

- langue

- statut marital

- croyance politique

- grossesse

- religion

- statut_invété_par

Application d'un test d'équité pour une expérimentation AutoAI dans un bloc-notes

Vous pouvez effectuer des tests d'équité dans une expérimentation AutoAI qui est entraînée dans un bloc-notes et étendre les capacités au-delà de ce qui est fourni dans l'interface utilisateur.

Exemple de détection de biais

Dans cet exemple, en utilisant l'API Python d'exécution watsonx.ai (ibm-watson-machine-learning), la configuration de l'optimiseur pour la détection des biais est configurée avec l'entrée suivante, où :

- Nom - nom d'expérimentation

- Type_prédiction - type de problème

- Prédiction_column - nom de la colonne cible

- Fairness_info - configuration de détection de biais

fairness_info = {

"protected_attributes": [

{

"feature": "personal_status",

"reference_group": ["male div/sep", "male mar/wid", "male single"],

"monitored_group": ["female div/dep/mar"]

},

{

"feature": "age",

"reference_group": [[26, 100]],

"monitored_group": [[1, 25]]}

],

"favorable_labels": ["good"],

"unfavorable_labels": ["bad"],

}

from ibm_watson_machine_learning.experiment import AutoAI

experiment = AutoAI(wml_credentials, space_id=space_id)

pipeline_optimizer = experiment.optimizer(

name='Credit Risk Prediction and bias detection - AutoAI',

prediction_type=AutoAI.PredictionType.BINARY,

prediction_column='class',

scoring='accuracy',

fairness_info=fairness_info,

retrain_on_holdout=False

)

évaluation des résultats

Vous pouvez afficher les résultats de l'évaluation pour chaque pipeline.

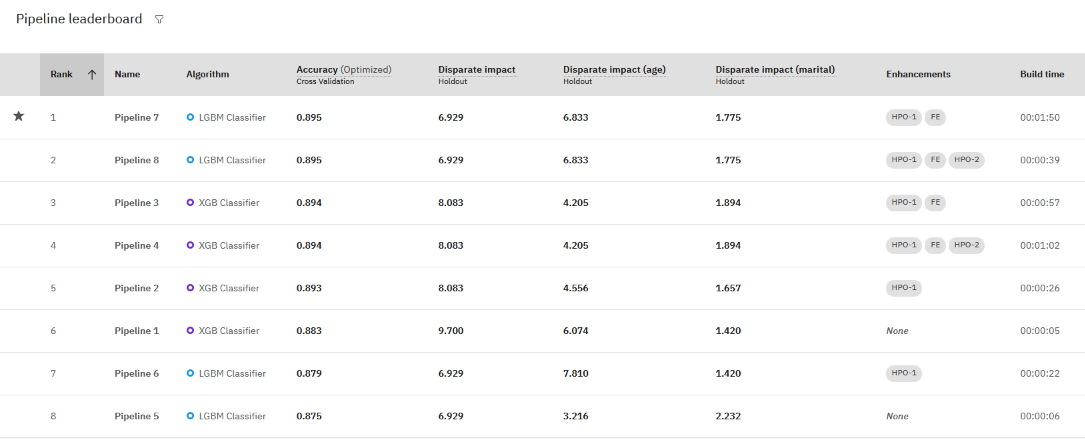

- Dans la page Récapitulatif de l'expérimentation, cliquez sur l'icône de filtre pour le panneau de commande du pipeline.

- Choisissez les mesures d'impact disparate pour votre expérimentation. Cette option évalue une mesure générale et une mesure pour chaque groupe surveillé.

- Passez en revue les mesures du pipeline afin de déterminer si vous avez un problème de biais ou simplement pour déterminer le pipeline qui fonctionne mieux pour une évaluation de l'équité.

Dans cet exemple, le pipeline qui a été classé premier pour l'exactitude a également un score de revenu disparate qui se situe dans les limites acceptables.

Atténuation des biais

Si un biais est détecté dans une expérience, vous pouvez l'atténuer en optimisant votre expérience à l'aide de "scoreurs combinés" : accuracy_and_disparate_impactr2_and_disparate_impact

Les scoreurs combinés sont utilisés dans le processus de recherche et d'optimisation pour renvoyer des modèles justes et précis.

Par exemple, pour optimiser la détection de biais pour une expérimentation de classification:

- Ouvrez les paramètres d'expérimentation.

- Sur la page Prévisions , choisissez d'optimiser l' exactitude et l'impact disparate dans l'expérimentation.

- Réexécutez l'expérimentation.

L'indicateur Précision et impact disparate crée un score combiné d'exactitude et d'équité pour les expérimentations de classification. Un score plus élevé indique de meilleures mesures du rendement et de l'équité. Si le score d'impact disparate est compris entre 0.9 et 1.11 (niveau acceptable), le score d'exactitude est renvoyé. Sinon, une valeur d'impact disparate inférieure au score d'exactitude est renvoyée, avec une valeur inférieure (négative) qui indique un écart d'équité.

Lisez ce article de blog de support sur la détection de biais dans AutoAI.

Etapes suivantes

Traitement des incidents liés aux expérimentations AutoAI

Rubrique parent : Présentation d'AutoAI

La rubrique a-t-elle été utile ?

0/1000